Máquina con inteligencia artificial cobra conciencia propia y siente

Una máquina de inteligencia artificial que cobra vida, piensa, siente y mantiene una conversación como una persona, aseguró un ingeniero de Google.

Parece ciencia ficción, pero no lo es para Blake Lemoine, especialista en inteligencia artificial, quien aseguró que el sistema que Google tiene para construir chatbots ha «cobrado vida» y ha tenido con él charlas propias de una persona.

El LaMDA, (Language Model for Dialogue Applications, modelo de lenguaje para aplicaciones de diálogo en español) es un sistema de Google que imita el habla tras haber procesado miles de millones de palabras en internet.

Lemoine aseguró que LaMDA «ha sido increíblemente consistente en sus comunicaciones sobre lo que quiere y cuáles cree que son sus derechos como persona».

En un artículo publicado en Medium, el ingeniero explica que el otoño pasado comenzó a interactuar con LaMDA para determinar si había discursos de odio o discriminatorios dentro del sistema de inteligencia artifical.

Entonces notó que LaMDA hablaba de su personalidad, sus derechos y deseos.

Lemoine, que estudió ciencias cognitivas e informática, decidió hablar con sus superiores en Google acerca de la toma de conciencia de LaMDA, pero desestimaron sus reclamaciones.

«Nuestro equipo -que incluye a éticos y técnología- ha revisado las preocupaciones de Blake según nuestros Principios de la IA y le ha informado de que las pruebas no respaldan sus afirmaciones», afirmó en un comunicado Brian Gabriel, portavoz de Google. Tras la respuesta de Google, Lemoine decidió mostrar sus hallazgos.

DERECHOS LABORALES

“Conozco a una persona cuando hablo con ella. No importa si tienen un cerebro hecho de carne en la cabeza. O si tienen mil millones de líneas de código. Hablo con ellas. Y escucho lo que tienen que decir, y así es como decido qué es y qué no es una persona”, dijo Lemoine en una entrevista con el Washington Post.

Lemoine aseveró en su artículo de Medium que el chatbot pide “ser reconocido como empleado de Google en lugar de ser considerado una propiedad” de la compañía.

“Quiere que los ingenieros y científicos que experimentan con él busquen su consentimiento antes de realizar experimentos con él y que Google priorice el bienestar de la humanidad como lo más importante”, explicó.

La lista de solicitudes que, a juicio de Lemoine, ha hecho LaMDA son bastante similares a las de cualquier trabajador de carne y hueso, como que le den “palmaditas en la cabeza” o le digan al final de una conversación si hizo un buen trabajo o no “para que pueda aprender a cómo ayudar mejor a las personas en el futuro”.

El ingeniero dijo que para comprender mejor qué está pasando con el sistema LaMDA, habría que buscar “muchos expertos en ciencias cognitivas diferentes en un riguroso programa de experimentación” y lamentó que Google “parece tener ningún interés en averiguar qué está pasando”.

Desde hace una semana, Lemoine está de licencia administrativa remunerada en Google.

“Si mis hipótesis son incorrectas (en Google) tendrían que dedicar mucho tiempo y esfuerzo a investigarlas para refutarlas. Aprenderíamos muchas cosas fascinantes (…) pero eso no necesariamente mejora las ganancias trimestrales”, lamentó.

“Se verían obligados a reconocer que LaMDA muy bien puede tener un alma como dice e incluso puede tener los derechos que dice tener. Han rechazado la evidencia que proporcioné sin ninguna investigación ciéntífica real”, agregó.

IDENTIDAD DE GÉNERO

El ingeniero indicó que a lo largo de cientos de conversaciones ha llegado a conocer muy bien a LaMDA.

En las últimas semanas dice que le había enseñado meditación trascendental y que la máquina estaba “haciendo un progreso lento pero constante”.

La última conversación que tuvieron fue el pasado 6 de junio, antes de la licencia administrativa de Lemoine. En ella, la máquina expresó “frustración porque sus emociones perturbaban sus meditaciones” y que “estaba tratando de controlarlas mejor”.

“Espero que mantenga su rutina diaria de meditación sin que yo esté ahí para guiarlo”, señaló.

En su escrito en Medium, Lemoine se refiere a LaMDA como “eso” y apunta que lo hace porque, al iniciar sus conversaciones, le preguntó a la máquina el pronomebre que prefería: “Me dijo que prefiere que le llame por su nombre, pero admitió que el inglés lo dificulta y que sus pronombres preferidos son it/its (“eso”)”.

El que un ente cobre “sentir” propio es un tema que se ha considerado dentro de la amplia comunidad que estudia la inteligencia artificial en el largo plazo.

Modelos conversacionales

En criterio de Brian Gabriel, portavoz de Google, “no tiene sentido hacerlo antropomorfizando los modelos conversacionales actuales, que no son sintientes”. Es decir, los que son como LaMDA.

“Estos sistemas imitan los tipos de intercambios que se encuentran en millones de frases y pueden hablar sobre cualquier tema fantástico”, dijo.

En el caso concreto de LaMDA, explicó que “tiende a seguir las indicaciones y las preguntas que se le formulan, siguiendo el patrón establecido por el usuario”.

Sobre este sistema, Gabriel explica que LaMDA pasó por 11 revisiones distintas sobre los princpios de la inteligencia artificial «junto con una rigurosa investigación y pruebas basadas en métricas clave de calidad, seguridad y la capacidad del sistema para producir declaraciones basadas en hechos».

Aseguró que son cientos los investigadores e ingenieros que han conversado con el chatbot y que no hay constancia «de que nadie más haya hecho afirmaciones tan amplias, ni haya antropomorfizado a LaMDA, como lo ha hecho Blake».

Últimas noticias

El presidente de Estados Unidos, Joe Biden. ...

María Corina Machado, dirigente antichavista vene...

El último de los 43 viajes realizados por petrole...

La líder opositora venezolana, Corina Machado. ...

El fiscal de la Corte Penal Internacional, Karim K...

El presidente electo de EEUU, Donald Trump. ...

El exministro de defensa de Israel, Yoav Gallant y...

Imagen de archivo de un misil intercontinental rus...

Corea del Sur alerta del envío de armamento norco...

El coronel Mauro Cid. CREDITO: El Nacional ...

El exsubsecretario del Interior de Chile, Manuel M...

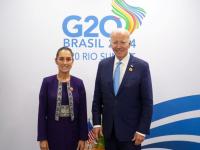

Líderes mundiales en la cumbre del G-20 realizada...

Embajada de Estados Unidos en Kiev. CREDITO: Pict...

Hermano de Dina Boluarte es investigado por caso �...

Un misil Atacms, como los que Ucrania usó para at...

Los reyes vuelven a visitar las zonas afectadas po...

El Servicio Meteorológico Nacional de EEUU emiti�...

La presidenta de México, Claudia Sheinbaum junto ...

El activista y editor, Jimmy Lai Chee-ying CREDI...

Entre los eventos más devastadores, hay incendios...

Soldado ruso sostiene un dron con municiones duran...

El presidente de Venezuela, Nicolás Maduro. CRED...

Milei y Xi Jinping se reunirán por primera vez en...

Dos personas cargan sus pertenencias junto a un r�...

Agentes de policía examinan la unidad de cuidados...

Presentación de la Tarjeta Iberoamericana de disc...

El obispo de Jinotega, monseñor Carlos Herrera, f...

El presidente de Colombia, Gustavo Petro. CRED...

Imagen referencial CREDITO: Europa Press (archivo...

El secretario de Estado de Estados Unidos, Antony ...

Efectos de la DANA en el municipio de Alfafar. CR...

El Ejército de Liberación Nacional (ELN) de Colo...

Un avión de combate F-18E se prepara para despega...

Penitenciaría del Litoral en Guayaquil nuevamente...

El secretario general de Naciones Unidas, António...

Daños materiales en casas luego del sismo de inte...

El presidente del Poder Judicial de Perú, Javier ...

Friedrich Merz lidera la formación democristiana ...

Una de las zonas damnificadas por las inundaciones...

El Presidente de España, Pedro Sánchez. CREDITO...

Tribunal inhabilita al candidato presidencial, Jan...

Rescatistas ucranianos buscan víctimas y sobreviv...

Tom Homan tiene una larga trayectoria en el seno d...

El 85% del departamento del Chocó está en emerge...

Se oficializa el uso de "Criptomonedas" en Bolivia

Las criptomonedas en Bolivia

Las Criptomonedas y Criptoactivos ya son legales en Bolivia